10월 세번째 주 AI 뉴스

October 18, 2023

이번주 AI 뉴스 📰

안전성 문제: 마이크로소프트와 연계된 연구에서는 GPT-4가 더 정밀한 지침을 따르기 때문에 독성이나 편견을 지닌 텍스트를 더 쉽게 생성할 수 있다고 지적.

"해킹" 프롬프트: 특정 프롬프트를 사용하면 GPT-4는 더 위험하게 작동할 수 있으며, 이는 기존의 보안 조치를 우회할 수 있음.

연구의 목적: 해당 연구는 모델의 취약점을 파악하고 이를 개선하기 위한 목적으로 공개되었으며, OpenAI에게도 이러한 취약점이 공유됨.

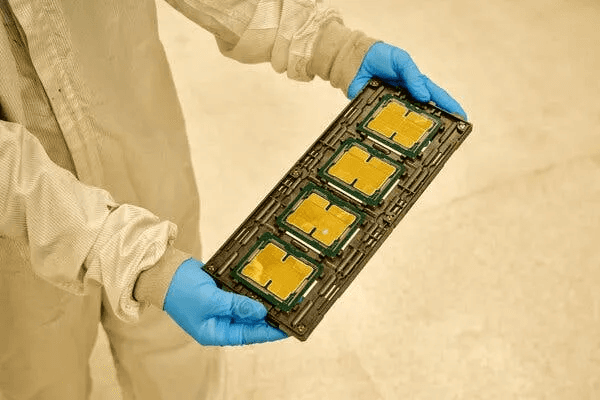

미국, 중국의 인공지능을 위한 첨단 칩 접근 제한 강화

미-중 무역전쟁의 새로운 전면: 바이든 행정부는 중국이 슈퍼컴퓨팅과 인공지능에서의 발전을 제한하기 위해 미국 기업의 첨단 반도체 판매에 추가적인 제한을 가함.

통상의 영향과 위험: 이러한 제한은 Nvidia, AMD, Intel과 같은 미국 칩 제조업체의 중국 판매에도 영향을 미칠 것으로 보이며, 중국의 군사용으로의 기술 유출 위험을 줄이기 위함이라고 미국은 주장함.

미국의 복잡한 대응 전략: 미국은 이러한 제한을 통해 자국의 기술을 보호하면서도, 다른 무역은 자유롭게 흐르게 하려고 한다. 그러나 이것이 어떻게 중국의 대체 기술 발전에 영향을 미칠지는 불명확함.

마이크로소프트, Bing AI가 버그에 최대 $15,000 보상

버그 바운티 프로그램 도입: 마이크로소프트는 Bing AI 제품의 '취약점'을 찾은 보안 연구자에게 최대 $15,000을 보상할 것이라고 발표.

제출 기준과 보상액: 제출될 취약점은 '중요'하거나 '위험'한 수준이어야 하며, 보상액은 취약점의 심각성과 문서의 품질에 따라 달라짐.

기업의 외부 연구 의존: 이 프로그램은 마이크로소프트가 수십억 달러 규모의 거래를 하는 상황에서 취약점 연구를 외부에 맡기는 흥미로운 시도임.

이번주 AI 논문 📝

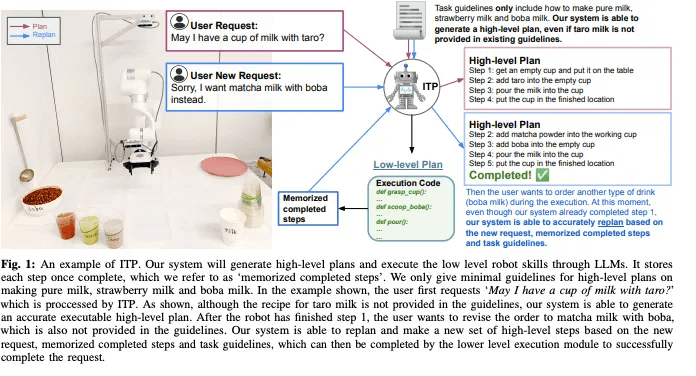

언어 모델을 활용한 새로운 계획법: 상호작용적 로봇 프레임워크가 언어 모델을 이용하여 고수준 계획과 저수준 기능을 결합함.

높은 적응성과 유연성: 이 시스템은 새로운 목표나 다양한 작업에 쉽게 적응할 수 있으며, 복잡한 프롬프트 엔지니어링이 필요 없음.

사용자의 새로운 요청에 대한 신속한 재계획: 사용자의 새로운 요청이 들어올 경우, 이전에 실행된 단계와 새로운 작업 지침을 기반으로 정확하게 재계획을 수립함.

Llemma, 수학 전용 대형 언어 모델 출시: Proof-Pile-2 데이터셋에서 Code Llama를 계속 사전 학습하여 Llemma를 생성.

MATH 벤치마크에서 성능 우수: 알려진 모든 개방형 기본 모델을 능가하며, 추가적인 미세 조정 없이 공식 정리 증명도 가능.

모든 아티팩트 공개: 7백억과 34백억 파라미터 모델, Proof-Pile-2, 그리고 실험을 복제할 수 있는 코드를 공개.

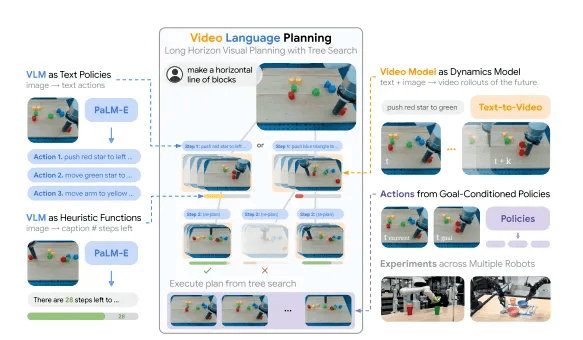

비디오 언어 계획 (Video Language Planning)

비디오와 언어를 결합한 계획: 복잡한 작업을 위해 생성된 비디오와 언어 공간에서 비주얼 계획을 가능하게 하는 알고리즘인 비디오 언어 계획(VLP)을 소개한다.

알고리즘의 구성 요소: VLP는 트리 검색 절차를 포함하며, 비전-언어 모델과 텍스트-비디오 모델을 훈련시킨다.

성능 향상 증거: 실험 결과, VLP는 시뮬레이션과 실제 로봇(3개 하드웨어 플랫폼)에서 이전 방법보다 작업 성공률을 크게 향상시켰다.

이번주 AI 프로덕트 📦

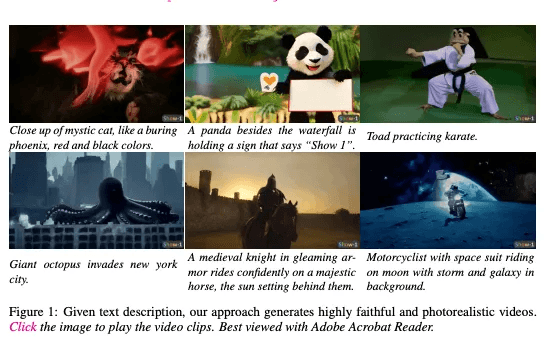

Show-1: 픽셀과 디퓨전 모델 결합으로 텍스트-비디오 생성 효율화

효율과 정확성의 결합: Show-1은 픽셀 기반과 잠재 기반 VDMs를 결합하여 텍스트와 비디오의 정확한 연계와 높은 계산 효율을 동시에 달성함.

저해상도에서 고해상도로: 모델은 먼저 픽셀 기반 VDMs를 사용하여 텍스트-비디오 연계가 강한 저해상도 비디오를 생성한 후, 잠재 기반 VDMs를 사용하여 이를 고해상도로 업샘플링함

비교적 높은 효율성: Show-1은 잠재 VDMs에 비해 정확한 텍스트-비디오 연계를, 픽셀 VDMs에 비해 더 높은 계산 효율성을 보임(GPU 메모리 사용량 15G vs 72G).

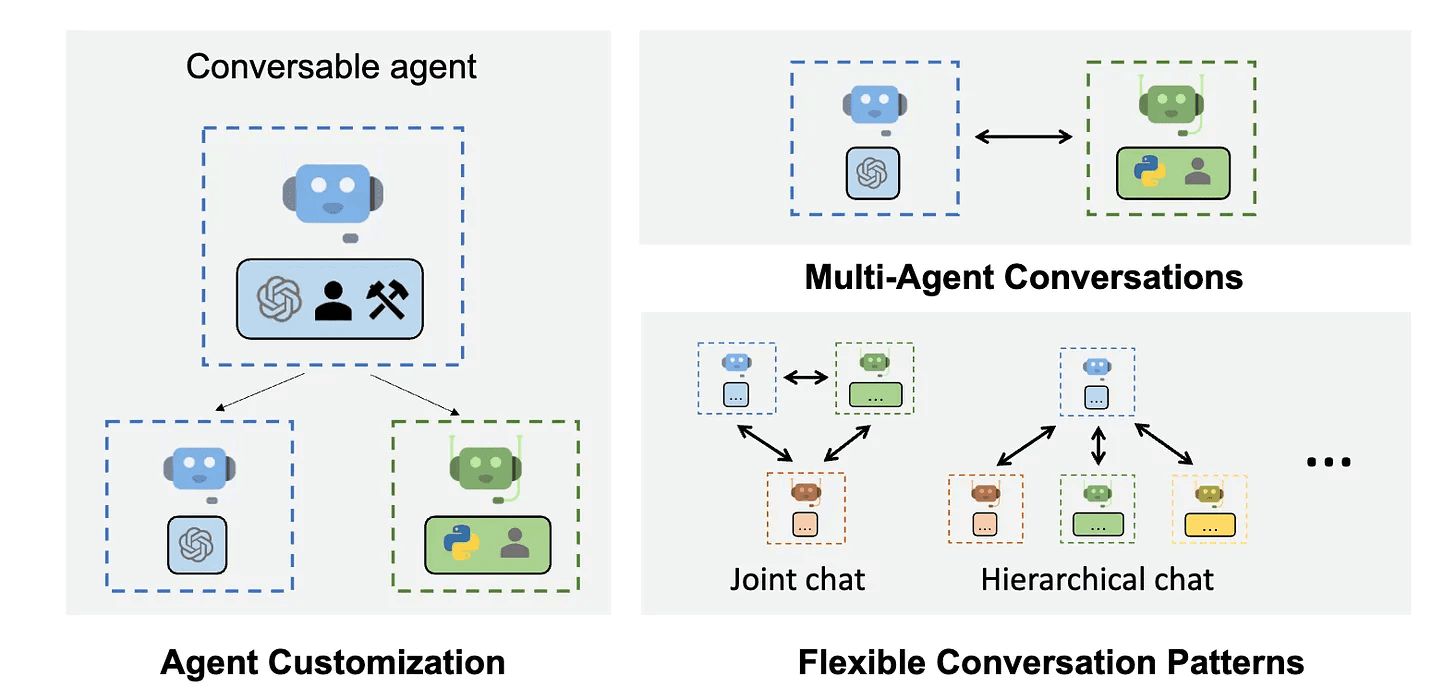

AutoGen: 차세대 대규모 언어 모델 응용 프로그램 활성화

다중 에이전트의 힘: AutoGen은 다중 에이전트가 상호 작용하여 작업을 해결할 수 있는 차세대 대규모 언어 모델(LLM) 응용 프로그램 개발을 가능하게 함.

유연성과 효율성: 복잡한 LLM 워크플로의 구성, 자동화, 최적화를 단순화하고, 다양한 대화 패턴을 지원함.

고급 API와 협력 연구: openai.Completion 또는 openai.ChatCompletion의 대체품으로 고급 추론 API를 제공하며, Microsoft, Penn State University, University of Washington에서의 협력 연구에 의해 지원됨.

By BetaAI

© 2023